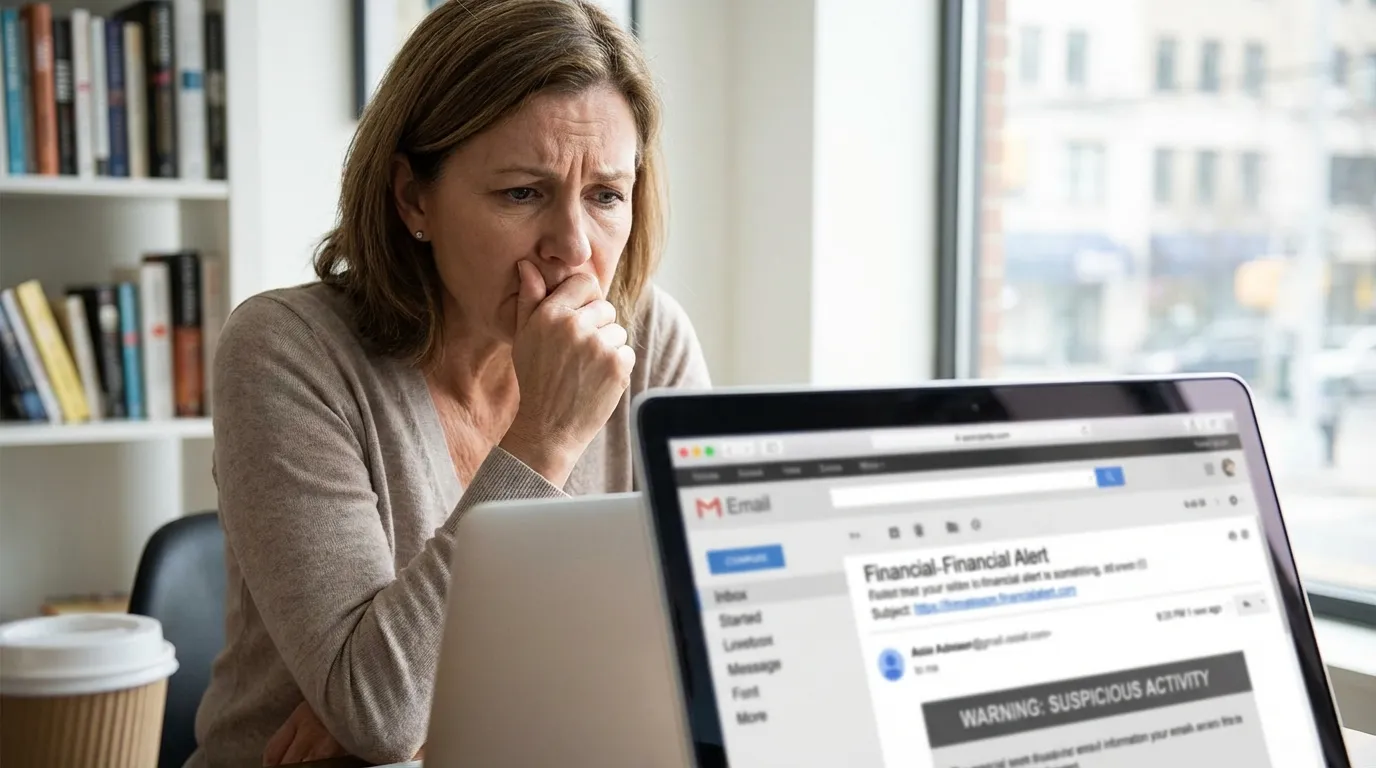

Les arnaques par clonage vocal restent une menace croissante, avertissent les experts

Bien qu'aucun nouvel incident massif isolé de deepfake vocal n'ait été signalé au cours des dernières 48 heures, les avis constatent une hausse générale de la fraude par clonage de voix. Les consommateurs et les entreprises sont invités à vérifier les demandes en recourant à des méthodes hors canal.

Les récents avis et les cas antérieurs documentés continuent de montrer que les escroqueries par clonage vocal constituent un vecteur de fraude en progression, même si aucun incident nouveau et majeur n’a été signalé au cours des 48 dernières heures. Les escrocs utilisent de plus en plus l’IA pour synthétiser des répliques vocales réalistes — se faisant passer pour des dirigeants, des membres de la famille ou des agents de service — afin d’autoriser des paiements, d’extorquer des identifiants ou de manipuler des victimes pour qu’elles transfèrent des fonds. Parce que les voix synthétisées peuvent être combinées à des scripts d’ingénierie sociale et à des détails contextuels réels, les victimes peuvent être convaincues d’agir sans vérification indépendante. Les experts conseillent aux organisations de mettre en place des protocoles de vérification stricts pour les autorisations financières (procédures de rappel, mots de passe, confirmations multi‑canal) et de former le personnel à traiter de manière sceptique les demandes vocales non sollicitées. Les consommateurs devraient limiter les échantillons vocaux disponibles publiquement, examiner attentivement les appels inattendus qui demandent de l’argent ou des identifiants, et utiliser l’authentification à deux facteurs lorsque cela est possible. Les régulateurs et les entreprises technologiques sont également encouragés à investir dans des outils de détection, le watermarking et des mesures politiques pour freiner les abus tout en équilibrant les usages légitimes de la technologie audio générative.

Articles liés

Hiya Report: 1 in 4 Americans Received AI Deepfake Voice Calls, Scammers Outpacing Carriers

Study finds deepfake-enabled fraud occurring on an 'industrial scale', AI Incident Database