CBS New York: KI-Stimmenklon-Betrugsmaschen können in Minuten die Stimme eines geliebten Menschen klonen, um Zahlungen zu erpressen

CBS New York zeigt, wie 30 Sekunden Audio überzeugende Stimmklone erzeugen können, die von Betrügern verwendet werden, um Familienmitglieder oder Amtspersonen zu imitieren. Reporter skizzieren praktische Schritte, um Identität zu überprüfen und zu vermeiden, durch geklonte Stimmen hereingelegt zu werden.

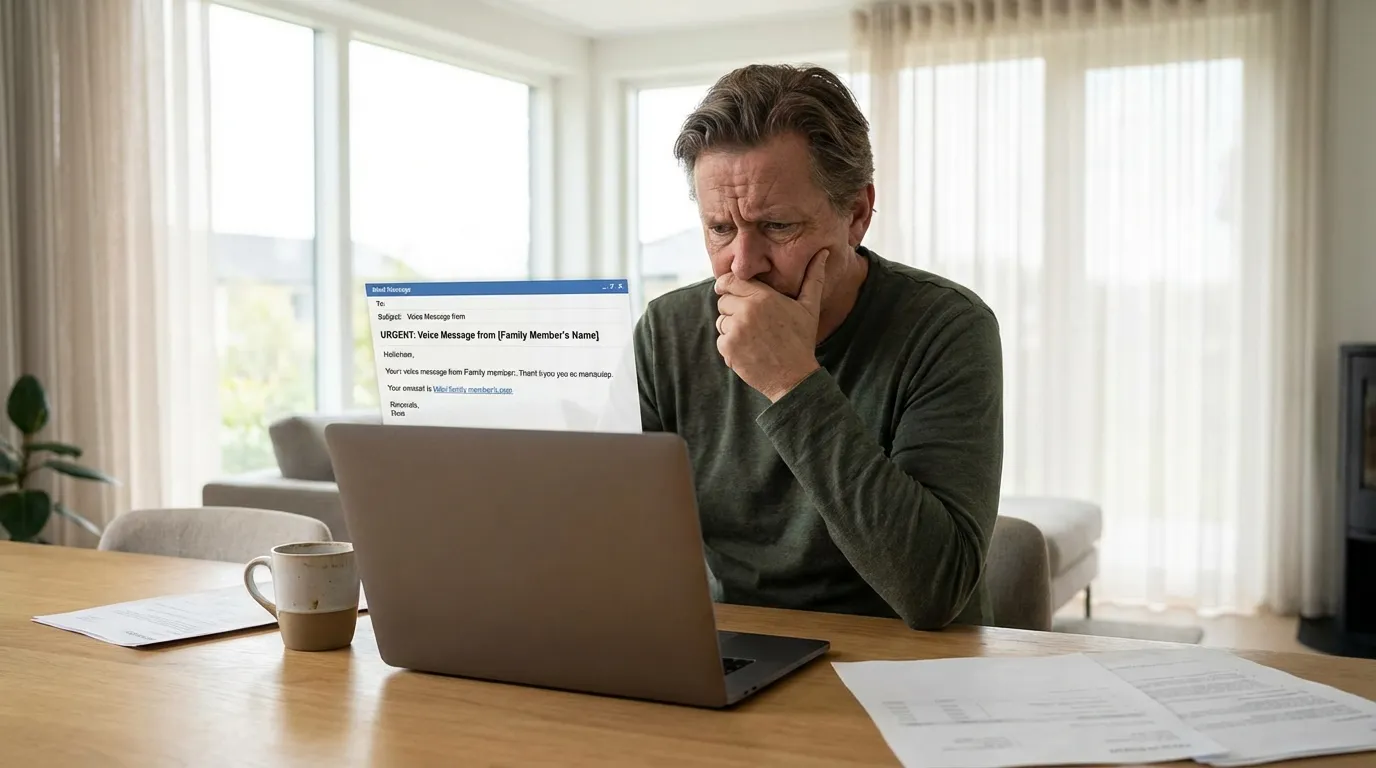

Eine CBS New York‑Untersuchung zeigt, wie schnell verfügbare KI‑Tools Stimmen mit nur 20–30 Sekunden Audio klonen können, wodurch Betrüger Angehörige, Freunde oder Autoritätspersonen imitieren können, um Geld oder sensible Informationen zu erlangen. Der Bericht enthält Demonstrationen, in denen geklonte Audiodateien verwendet wurden, um glaubhafte Notrufe und gefälschte Anweisungen zu erstellen, was den emotionalen Hebel veranschaulicht, den Betrüger ausnutzen, um rationaler Prüfung zu entgehen. Die befragten Experten raten zu mehreren Verifikationsschritten: unter einer bekannten Nummer zurückrufen, Fragen stellen, die nur die echte Person beantworten könnte, ein Live‑Video verlangen und vermeiden, auf Aufforderung Geld zu senden oder Kryptowährung zu überweisen. Die Strafverfolgungsbehörden warnen, dass Stimmklonen zunehmend mit Social Engineering, Deepfake‑Video und Phishing kombiniert wird, um multimodale Betrugsfälle zu schaffen, die schwerer zu erkennen sind. Verbrauchern wird geraten, bei dringenden Audioanfragen skeptisch zu sein, die Zwei‑Faktor‑Authentifizierung für Konten zu aktivieren und Nachahmungsversuche der örtlichen Polizei sowie den Plattformen zu melden, auf denen der Betrug seinen Ursprung hatte. Die Geschichte hebt die Dringlichkeit hervor, dass Plattformen, Regulierungsbehörden und Verbraucher Authentifizierungsmaßnahmen und Aufklärungskampagnen einführen.

Verwandte Betrugsarten

Verwandte Artikel

Hiya Report: 1 in 4 Americans Received AI Deepfake Voice Calls, Scammers Outpacing Carriers

Study finds deepfake-enabled fraud occurring on an 'industrial scale', AI Incident Database