CBS New York : Les arnaques de clonage vocal par IA peuvent cloner un proche en quelques minutes pour extorquer des paiements

CBS New York montre comment 30 secondes d'audio peuvent produire des clones vocaux convaincants utilisés par des arnaqueurs pour se faire passer pour des membres de la famille ou des responsables. Les reporters décrivent des mesures pratiques pour vérifier l'identité et éviter d'être trompé par des voix clonées.

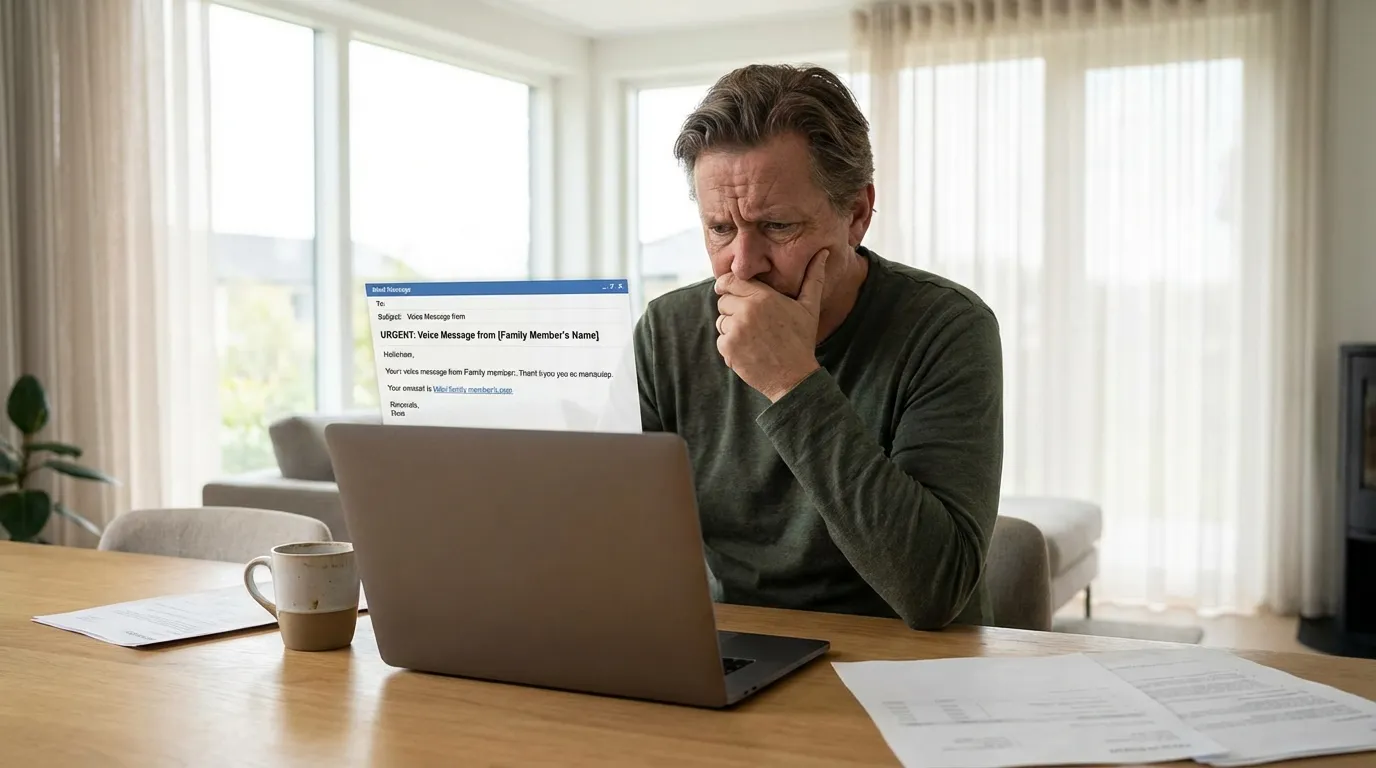

Une enquête de CBS New York montre à quelle vitesse des outils d'IA accessibles peuvent cloner des voix avec seulement 20–30 secondes d'audio, permettant aux escrocs d'usurper des proches, des amis ou des figures d'autorité pour extorquer de l'argent ou des informations sensibles. Le reportage inclut des démonstrations où des enregistrements clonés ont été utilisés pour créer des appels à l'aide d'urgence crédibles et de faux ordres, illustrant le levier émotionnel exploité par les escrocs pour échapper à un examen rationnel. Les experts interviewés conseillent plusieurs étapes de vérification : rappeler sur un numéro connu, poser des questions que seule la vraie personne connaîtrait, demander une vidéo en direct et éviter d'envoyer de l'argent ou de transférer des cryptomonnaies sur demande. Les forces de l'ordre avertissent que le clonage vocal sera de plus en plus associé à l'ingénierie sociale, à la vidéo deepfake et au phishing pour créer des escroqueries multimodales plus difficiles à détecter. Il est conseillé aux consommateurs d'être sceptiques face aux demandes audio urgentes, d'activer l'authentification à deux facteurs sur leurs comptes et de signaler les tentatives d'usurpation à la police locale et aux plateformes d'où provient l'arnaque. L'enquête souligne l'urgence pour les plateformes, les régulateurs et les consommateurs d'adopter des mesures d'authentification et des campagnes de sensibilisation publiques.

Arnaques similaires

Articles liés

Hiya Report: 1 in 4 Americans Received AI Deepfake Voice Calls, Scammers Outpacing Carriers

Study finds deepfake-enabled fraud occurring on an 'industrial scale', AI Incident Database