CBS New York: Мошенничества с клонированием голоса ИИ могут за считанные минуты воссоздать голос близкого, чтобы вымогать деньги

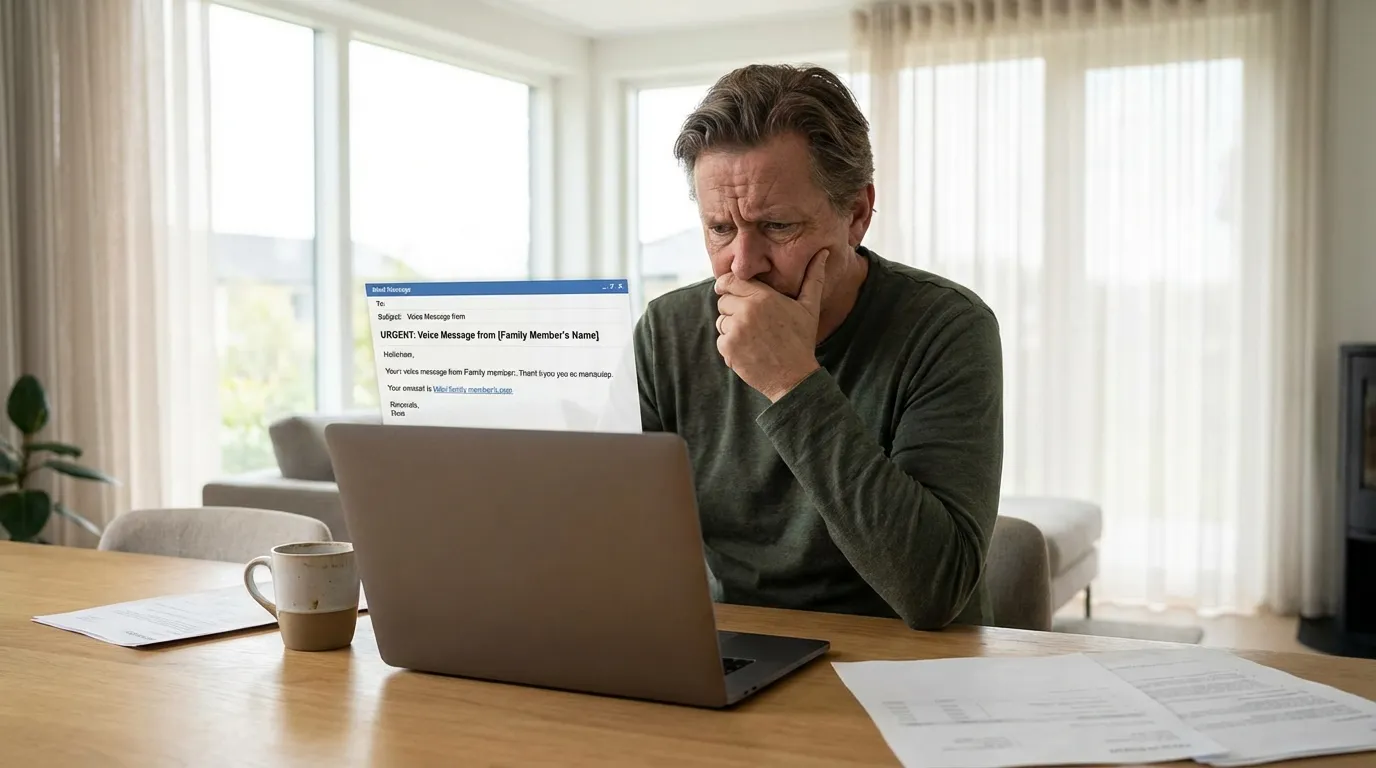

CBS New York демонстрирует, как 30 секунд аудиозаписи могут создать убедительные голосовые клоны, которыми мошенники пользуются, чтобы выдать себя за членов семьи или должностных лиц. Репортёры описывают практические шаги по проверке личности и по тому, как не попасться на уловки с клонированными голосами.

Расследование CBS New York показывает, как быстро доступные инструменты ИИ могут клонировать голоса всего по 20–30 секундам аудио, позволяя мошенникам выдавать себя за родственников, друзей или должностных лиц, чтобы выманить деньги или конфиденциальную информацию. В репортаже показаны демонстрации, где клонированная аудиозапись использовалась для создания правдоподобных экстренных мольб и фальшивых распоряжений, иллюстрируя эмоциональное давление, которое мошенники используют, чтобы обойти рациональную проверку. Опрошенные эксперты советуют применять несколько шагов проверки: перезвонить по известному номеру, задать вопросы, на которые ответит только настоящий человек, запросить живое видео и не переводить деньги и не отправлять криптовалюту по требованию. Правоохранительные органы предупреждают, что клонирование голоса всё чаще будет сочетаться с социальной инженерией, дипфейк‑видео и фишингом, создавая мультимодальные мошеннические схемы, которые труднее обнаружить. Потребителям советуют скептически относиться к срочным аудиозапросам, включить двухфакторную аутентификацию для аккаунтов и сообщать о попытках выдачи себя за другого в местную полицию и на платформы, где возникло мошенничество. История подчёркивает срочность для платформ, регуляторов и потребителей внедрить меры аутентификации и кампании по повышению осведомлённости общественности.

Похожие статьи

Hiya Report: 1 in 4 Americans Received AI Deepfake Voice Calls, Scammers Outpacing Carriers

Study finds deepfake-enabled fraud occurring on an 'industrial scale', AI Incident Database