CBS New York: Las estafas de clonación de voz con IA pueden clonar a un ser querido en minutos para extorsionar pagos

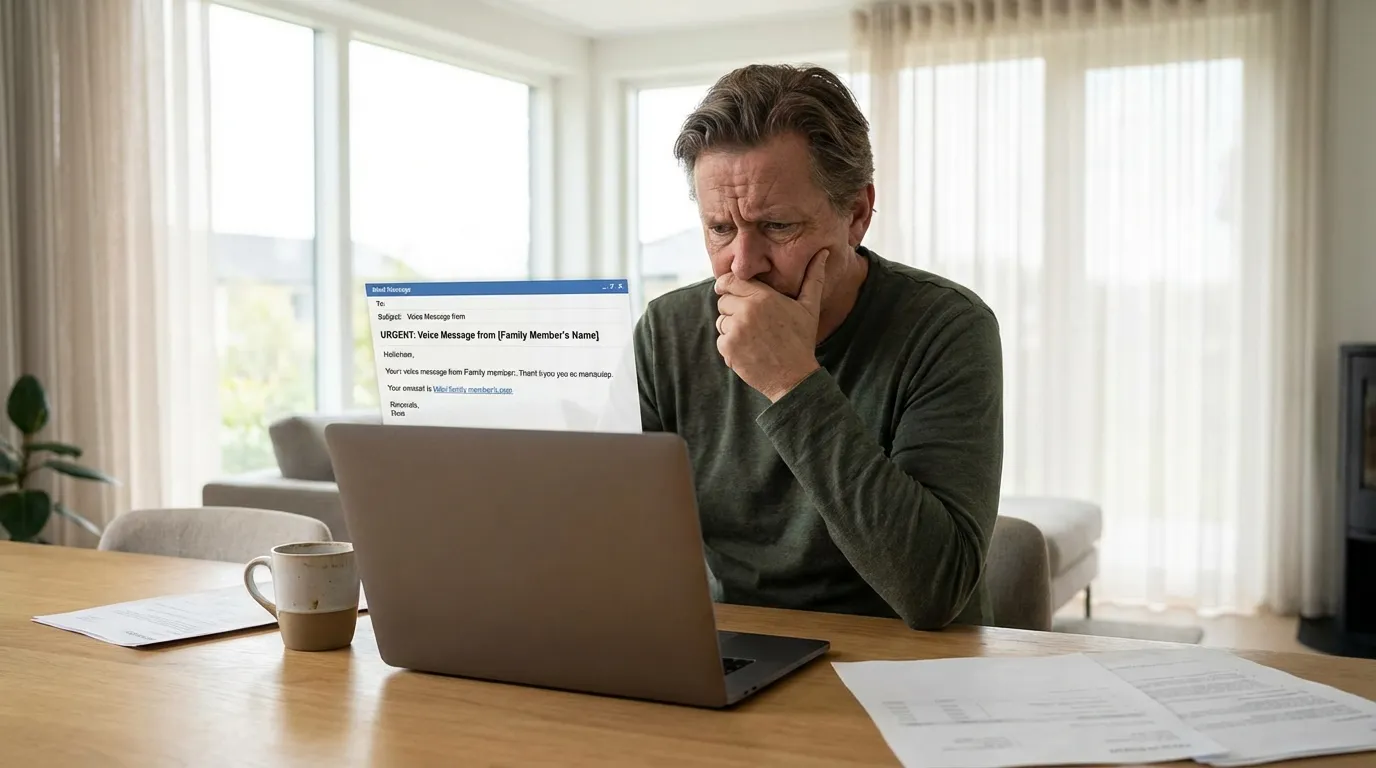

CBS New York demuestra cómo 30 segundos de audio pueden producir clones de voz convincentes utilizados por estafadores para hacerse pasar por familiares o funcionarios. Los reporteros describen pasos prácticos para verificar la identidad y evitar ser engañados por voces clonadas.

Una investigación de CBS New York muestra con qué rapidez las herramientas de IA disponibles pueden clonar voces con tan solo 20–30 segundos de audio, lo que permite a los estafadores hacerse pasar por familiares, amigos o figuras de autoridad para obtener dinero o información sensible. El informe incluye demostraciones en las que el audio clonado se utilizó para crear súplicas de emergencia creíbles y directivas falsas, ilustrando la palanca emocional que los estafadores explotan para eludir el escrutinio racional. Los expertos entrevistados aconsejan múltiples pasos de verificación: devolver la llamada a un número conocido, hacer preguntas que solo la persona real sabría responder, solicitar un video en vivo y evitar enviar dinero o transferir criptomonedas bajo demanda. Las fuerzas del orden advierten que la clonación de voz cada vez se combinará más con ingeniería social, video deepfake y phishing para crear estafas multimodales que son más difíciles de detectar. Se aconseja a los consumidores ser escépticos ante solicitudes de audio urgentes, activar la autenticación de dos factores en las cuentas y denunciar intentos de suplantación a la policía local y a las plataformas donde se originó la estafa. La historia destaca la urgencia de que las plataformas, los reguladores y los consumidores adopten medidas de autenticación y campañas de concienciación pública.

Estafas relacionadas

Artículos relacionados

Hiya Report: 1 in 4 Americans Received AI Deepfake Voice Calls, Scammers Outpacing Carriers

Study finds deepfake-enabled fraud occurring on an 'industrial scale', AI Incident Database