Las estafas de clonación de voz siguen siendo una amenaza creciente, advierten los expertos

Aunque no se informó de ningún incidente nuevo, masivo y único de deepfake de voz en las últimas 48 horas, los avisos señalan un aumento general del fraude mediante clonación de voz. Se insta a consumidores y empresas a verificar las solicitudes mediante métodos fuera de banda.

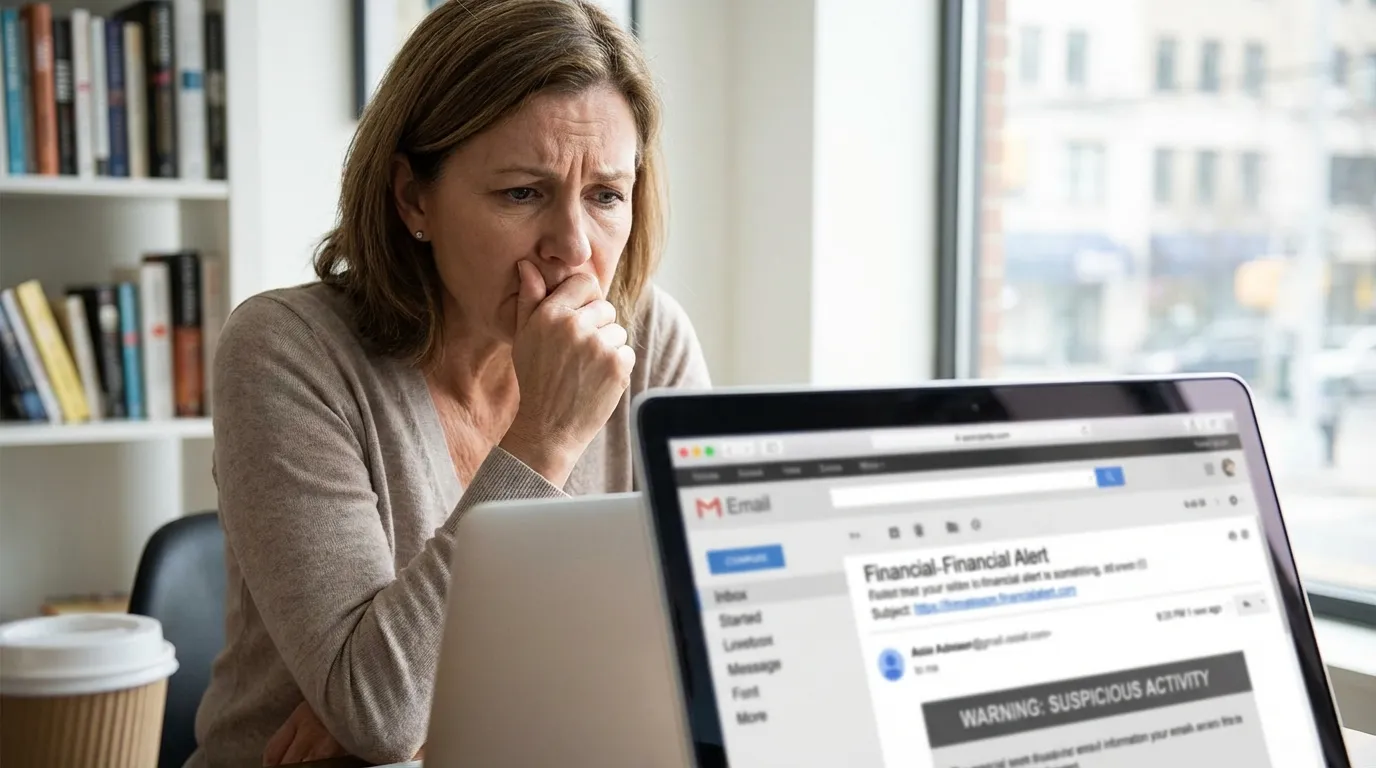

Los avisos recientes y casos documentados previos siguen mostrando las estafas de clonación de voz como un vector de fraude en aumento, aunque no se haya reportado un único incidente nuevo y de gran magnitud en las últimas 48 horas. Los estafadores utilizan cada vez más la IA para sintetizar réplicas de voz realistas —haciendo pasar por ejecutivos, familiares o agentes de servicio— para autorizar pagos, extraer credenciales o manipular a las víctimas para que transfieran fondos. Debido a que las voces sintetizadas pueden mezclarse con guiones de ingeniería social y detalles contextuales reales, las víctimas pueden verse convencidas de actuar sin verificación independiente. Los expertos aconsejan a las organizaciones implementar protocolos estrictos de verificación para autorizaciones financieras (procedimientos de devolución de llamada, palabras clave, confirmación multicanal) y capacitar al personal para que trate con escepticismo las solicitudes de voz no solicitadas. Los consumidores deberían limitar las muestras de voz disponibles públicamente, escrutar las llamadas inesperadas que soliciten dinero o credenciales y usar la autenticación de dos factores cuando sea posible. También se insta a los reguladores y a las empresas tecnológicas a invertir en herramientas de detección, marcas de agua y medidas políticas para frenar el abuso mientras se equilibran los usos legítimos de la tecnología de audio generativo.

Artículos relacionados

Hiya Report: 1 in 4 Americans Received AI Deepfake Voice Calls, Scammers Outpacing Carriers

Study finds deepfake-enabled fraud occurring on an 'industrial scale', AI Incident Database