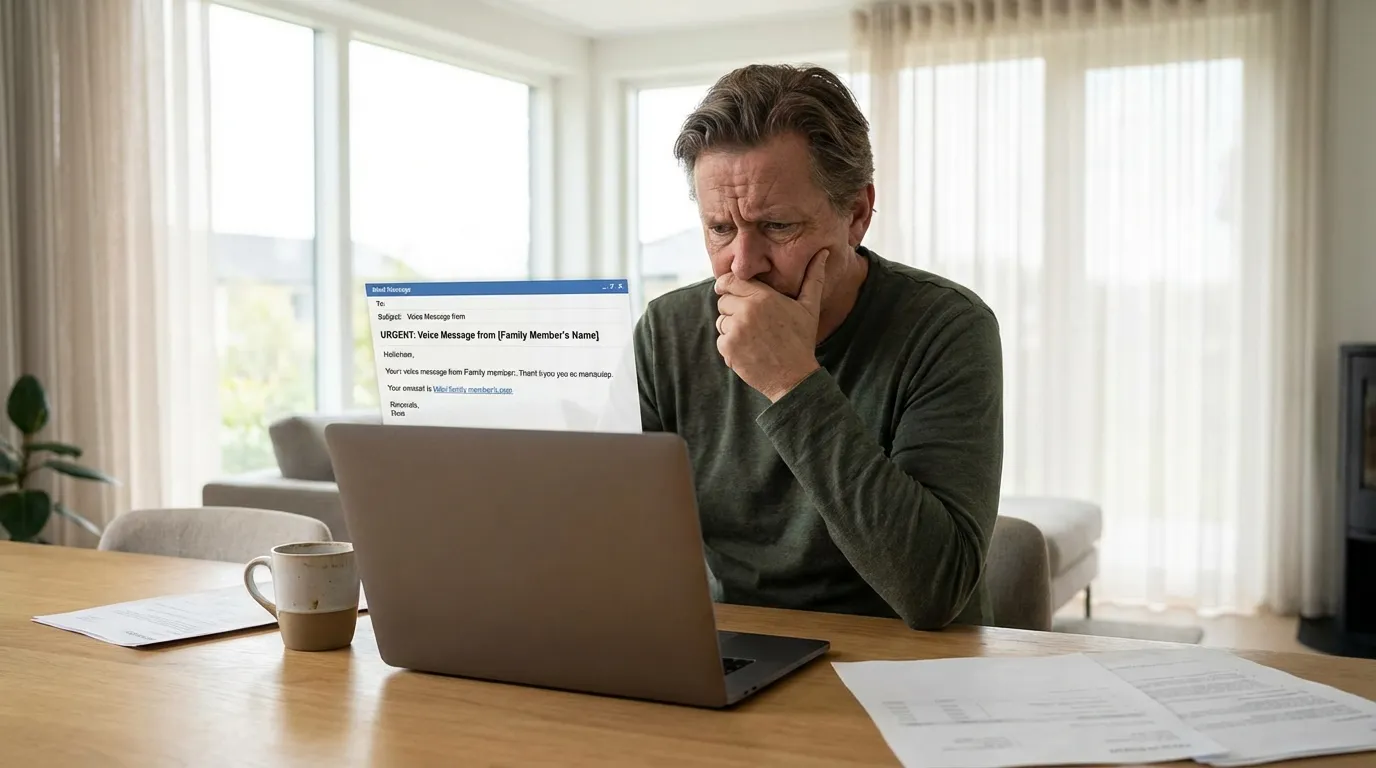

CBS New York: Golpes de clonagem de voz por IA podem clonar um ente querido em minutos para extorquir pagamentos

CBS New York demonstra como 30 segundos de áudio podem produzir clones de voz convincentes usados por golpistas para se passar por familiares ou autoridades. Repórteres descrevem passos práticos para verificar identidade e evitar ser enganado por vozes clonadas.

Uma investigação da CBS New York mostra como ferramentas de IA rapidamente disponíveis podem clonar vozes com apenas 20–30 segundos de áudio, permitindo que golpistas se passem por parentes, amigos ou figuras de autoridade para extorquir dinheiro ou obter informações sensíveis. O relatório inclui demonstrações em que áudio clonado foi usado para criar súplicas de emergência críveis e diretivas falsas, ilustrando o apelo emocional que os golpistas exploram para contornar o escrutínio racional. Especialistas entrevistados aconselham múltiplas etapas de verificação: ligar de volta para um número conhecido, fazer perguntas que somente a pessoa real saberia responder, solicitar um vídeo ao vivo e evitar enviar dinheiro ou transferir criptomoeda mediante solicitação. As autoridades alertam que a clonagem de voz será cada vez mais combinada com engenharia social, vídeo deepfake e phishing para criar golpes multimodais que são mais difíceis de detectar. Recomenda‑se que os consumidores desconfiem de pedidos urgentes por áudio, habilitem a autenticação de dois fatores nas contas e denunciem tentativas de personificação à polícia local e às plataformas onde o golpe teve origem. A reportagem destaca a urgência de que plataformas, reguladores e consumidores adotem medidas de autenticação e campanhas públicas de conscientização.

Golpes relacionados

Artigos relacionados

Hiya Report: 1 in 4 Americans Received AI Deepfake Voice Calls, Scammers Outpacing Carriers

Study finds deepfake-enabled fraud occurring on an 'industrial scale', AI Incident Database